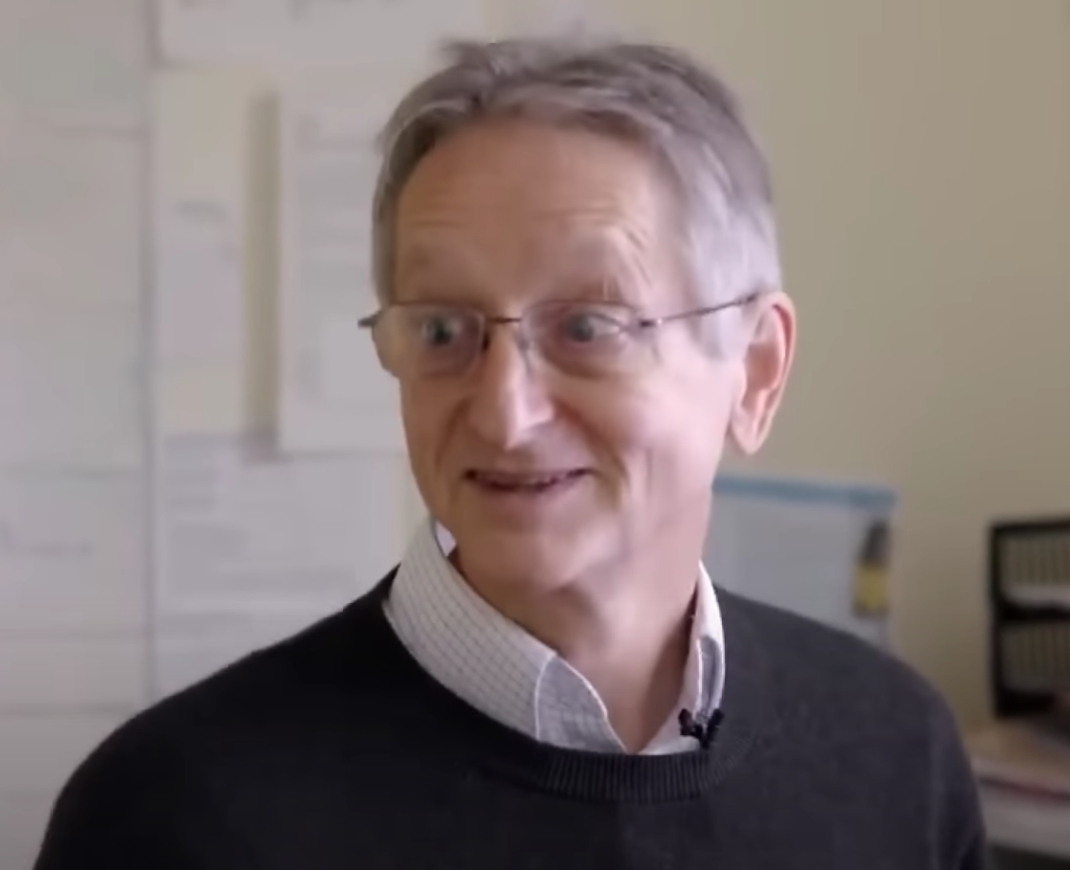

Tân Thế Kỷ (TTK) – Không ai nghĩ rằng sau một đêm thức dậy cả giới công nghệ bàng hoàng. Vào ngày 1/5/2023, trên báo New York Times, nhà tiên phong trong lĩnh vực trí tuệ nhân tạo (AI) – Tiến sĩ Geoffrey Hinton tuyên bố với thế giới thông tin ông đã rời khỏi Google từ cuối tháng 4. Ông bày tỏ sự hối hận vì cả cuộc đời làm việc của mình vẫn không thể ngăn chặn được cuộc chiến giữa con người và AI.

Trên trang nhất của tờ New York Times xuất hiện bài viết với tiêu đề: ‘Ông trùm AI’ rời Google và cảnh báo nguy hiểm phía trước.

Tại sao là ông trùm AI

Bốn năm trước, khi Bloomberg Originals phỏng vấn Hinton, vì Hinton phải đứng làm việc trong 12 năm do chấn thương lưng, nên phóng viên nói đùa: “Ngài đúng là bắt kịp với xu hướng “đứng làm việc” ngày nay”. Hinton cười và đáp lời: “Tôi dẫn đầu xu thế”.

Trên thực tế, Hinton nổi tiếng “đi trước xu hướng” trong lĩnh vực công nghệ học sâu (deep learning). Vào những năm mà mọi người không mấy lạc quan về mạng nơ-ron nhân tạo, ông đã đưa công nghệ này vào giới học thuật chính thống.

Vậy Hinton là ai? Ông sinh ngày 6/12/1947 trong một gia đình trí thức ở Anh. Hầu hết các thành viên trong gia đình ông là nhà toán học, triết học gia, nhà logic toán học, nhà kinh tế học và nhà giáo dục. Rõ ràng, trong một gia đình có nền tảng học thức như vậy, khiến tuổi thơ của Hinton khá áp lực.

Ông từng chia sẻ: “Khi khoảng 7 tuổi, tôi ý thức rằng không làm tiến sỹ là không được”. Hinton tốt nghiệp bằng Cử nhân Tâm lý học Thực nghiệm tại Đại học Cambridge năm 1970. Ông hoàn thành bằng tiến sĩ về Trí tuệ nhân tạo tại Đại học Edinburgh vào năm 1978. Sau đó, ông từng làm việc tại Đại học Sussex; Đại học California, San Diego; Đại học Cambridge; Đại học Carnegie Mellon và Đại học London.

Hinton là người sáng lập Trung tâm khoa học thần kinh máy tính Gatsby. Ông là học giả hàng đầu của Canada trong lĩnh vực học máy và là trưởng dự án “Điện toán thần kinh và Nhận thức thích ứng” do Viện Nghiên cứu Cao cấp Canada tài trợ.

Tuy nhiên, điều ban đầu đã dẫn Hinton đến với con đường trí tuệ nhân tạo là do sự tò mò của ông về não bộ con người. Hinton đã sớm bị ám ảnh bởi cách thức hoạt động của bộ não. Vì vậy, ông đã học thêm về sinh lý học, thông qua giải phẫu não bộ, ông đã tìm hiểu cách nó hoạt động như thế nào. Sau đó, ông đến Cambridge để nghiên cứu tâm lý học thực nghiệm.

Cuối cùng, ông quyết định sử dụng các phương pháp khoa học máy tính để mô phỏng bộ não, bước vào lĩnh vực AI và bắt đầu sự nghiệp nghiên cứu gần 40 năm của mình. Vào tháng 3 năm 2013, Google đã mua lại công ty DNN Research do ông thành lập với giá 44 triệu đô la. Đồng thời, Hinton gia nhập Google.

Năm 2018, Hinton, Yann LeCun cùng Yoshua Bengio đã giành được giải thưởng Turing vì những đóng góp cho nghiên cứu về mạng nơ-ron nhân tạo. Mạng nơ-ron nhân tạo chính xác là công nghệ nền tảng của Chatbot như ChatGPT.

Ngày nay, không ai trong giới AI là chưa từng nghe đến Hinton. Ông là người đứng đầu nhóm nghiên cứu Google Brain, là giáo sư danh dự tại Đại học Toronto. Chính những đóng góp của ông cho công nghệ mạng nơ-ron nhân tạo đa tầng đã xác lập địa vị “ông trùm” trong giới AI ngày nay của ông.

Vậy Hinton đã có những đóng góp gì cho AI? Năm 1986, Hinton đề xuất lý thuyết lan truyền ngược để huấn luyện mạng sâu. Lan truyền ngược (Backpropagation), hiện là phương pháp được sử dụng phổ biến nhất và hiệu quả nhất để huấn luyện mạng nơ-ron nhân tạo.

Lý thuyết sử dụng lan truyền ngược để đào tạo mạng sâu, đã đánh dấu một bước ngoặt trong sự phát triển của học sâu, đặt nền móng cho sự phát triển của AI trong những năm gần đây. Cái gọi là học sâu là một loại AI được sử dụng để dạy máy tính xử lý dữ liệu theo cách lấy cảm hứng từ bộ não con người.

Mô hình học sâu có thể nhận dạng hình ảnh, văn bản, âm thanh và các mô thức phức tạp khác trong dữ liệu, từ đó đưa ra những hiểu biết và dự đoán chính xác.

Điều đó có nghĩa là ngày nay Google sử dụng nhận dạng giọng nói truy xuất hình ảnh, công nghệ chuyển giọng nói thành văn bản trên điện thoại di động phần lớn là nhờ công lao nghiên cứu của Hinton. Có thể nói, nghiên cứu của ông đã tạo ra một cuộc cách mạng về AI và thậm chí toàn bộ quỹ đạo phát triển của nhân loại.

Tuy nhiên, khi mạng nơ-ron nhân tạo đầu tiên xuất hiện, nó có số phận không mấy tốt đẹp. Một trong những người đầu tiên bắt chước cấu trúc của hệ thống thị giác nhận dạng mẫu tự động của cơ thể con người là một nhà tâm lý học nhận thức người Mỹ và là giáo sư tại Đại học Cornell – ông Frank Rosenblatt.

Năm 1957, Rosenblatt nhận chức tại phòng thí nghiệm hàng không Cornell. Trong thời gian đó, ông đã phát minh ra mạng nơ-ron thần kinh nhân tạo được gọi là máy tri giác (Perceptron).

Bất cứ ai tiếp xúc với thần kinh học đều biết rằng, kết cấu của các tế bào thần kinh có thể chia thành đuôi gai, khớp thần kinh, thân tế bào và sợi trục. Trạng thái của một nơ-ron phụ thuộc vào trạng thái của các nơ-ron khác, lượng đầu vào nhận được và sức mạnh của khớp thần kinh. Khi tổng các tín hiệu nhận được vượt quá một ngưỡng nhất định, thân tế bào sẽ tạo ra một xung điện.

Các xung điện di chuyển dọc theo sợi trục và qua khớp thần kinh, truyền đến các tế bào thần kinh khác. Đây là cách các tế bào thần kinh hoạt động. Dựa trên nguyên tắc này, Rosenblatt đã phát minh ra Perceptron. Bắt chước cách tính toán của bộ não con người, giống như cách chúng ta lấy dữ liệu từ các giác quan của mình, mạng nơ-ron nhân tạo có thể chấp nhận dữ liệu đến và học hỏi từ dữ liệu đó. Từ đó, mạng nơ-ron có thể đưa ra phán đoán và quyết định của riêng nó dựa trên dữ liệu theo thời gian.

Nhưng thuật toán học của Rosenblatt chỉ dùng được cho mạng nơ-ron có cấu trúc một lớp, chứ không có tác dụng đối với các mạng nơ-ron nhiều lớp. Do đó, nó đã bị các học giả AI loại bỏ. Khi đó, ngoại trừ Hinton, hầu như không ai tin vào tiềm năng của mạng nơ-ron, và không ai nghiên cứu nó nữa. Vì vậy, điều gì khiến Hinton không bỏ cuộc?

Ông nói rằng bởi vì mọi người đều đã sai lầm. Ông cho rằng bộ não con người là một mạng nơ-ron khổng lồ nên mạng nơ-rơn chắc chắn cũng có thể hoạt động. Mặc dù vậy, tại sao Hinton sau 10 năm làm việc tại Google lại bất ngờ tuyên bố từ chức và cảnh báo nguy hiểm phía trước?

‘Ông trùm’ sợ điều gì?

Hinton đã đi nhiều nơi khắp nước Mỹ để tìm một tổ chức có thể hỗ trợ ông trong nghiên cứu mạng nơ-ron. Vào thời điểm đó, hầu hết các nghiên cứu học thuật ở Hoa Kỳ đều được Bộ Quốc phòng hỗ trợ.

Bộ Quốc phòng cũng rất sẵn sàng tài trợ cho nghiên cứu của Hinton. Và dĩ nhiên ai cũng hiểu rằng, nếu nhận kinh phí này, thì kết quả nghiên cứu sẽ phải cung cấp cho Bộ Quốc phòng sử dụng. Trên thực tế, kể từ khi ra đời, học sâu đã có mối quan hệ không thể tách rời với một số mục đích quân sự của Bộ Quốc phòng. Tuy nhiên, Hinton đã không nhận tài trợ từ Bộ Quốc phòng. Ông là một người có quy chuẩn đạo đức. Ông không muốn thành quả nghiên cứu của mình bị dùng cho mục tiêu xấu.

Để tránh phải phục vụ trong Lầu năm góc, Hinton đã dừng chân tại Đại học Toronto ở Canada. Đất nước Canada chào đón ông, và ông đã không để Canada thất vọng. Ông đưa Canada lên bản đồ siêu cường về AI. Do đó, nhiều ‘gã khổng lồ’ AI đã thành lập trung tâm nghiên cứu ở Toronto để theo bước chân của Hinton. Tất cả các tài năng hàng đầu cũng liên tiếp đến đất nước phía bắc này. Còn bây giờ, Hinton muốn phá hủy đế chế mà bản thân ông đã tạo ra. Ông đang lo sợ điều gì?

Ngày 1/5/2023, trên Twitter, Hinton đã viết rằng: “Trên tờ New York Times hôm nay, Cade Metz ám chỉ rằng tôi rời khỏi Google vì muốn chỉ trích Google. Thực ra, tôi rời đi để nói về sự nguy hiểm của AI, mà không cần cân nhắc điều này sẽ ảnh hưởng đến Google như thế nào. Google đã hành động rất có trách nhiệm”.

Vào ngày 3/5 vừa qua, Hinton đã tham gia phỏng vấn với BBC. Ông cho biết: “Vấn đề bây giờ là chúng tôi nhận thấy rằng AI đang hoạt động tốt hơn những gì mà từ vài năm trước chúng tôi kỳ vọng. Chúng ta cần làm gì đó để giảm rủi ro dài hạn, không để những thứ thông minh do chúng ta tạo ra quay lại kiểm soát chúng ta”.

Điều khiến Hinton lo lắng nhất, cũng là điều mà công chúng quan tâm nhất, chính là AI có thể tự động tạo ra rất nhiều nội dung và văn bản giả mạo. Ngoài các vấn đề xã hội như thư rác, điều quan trọng nhất là AI thậm chí có thể khiến các nhà lãnh đạo có thẩm quyền thao túng cử tri. Điều đó có nghĩa là sự tồn tại của AI sẽ dẫn đến sự sụp đổ hoàn toàn của “trung thực” và “chính trực” vốn làm nên chuẩn mực và đạo đức cơ bản nhất của con người.

Nhưng đây không phải là điều Hinton muốn nói nhất. Điều ông muốn nói là khi những công nghệ thông minh này trở nên thông minh hơn con người, sẽ xuất hiện nguy cơ sinh tồn. Bởi vì trí thông minh của AI khác với con người. Con người là hệ thống sinh vật, còn AI là kỹ thuật số. Sự khác biệt lớn nhất giữa hai cái là hệ thống số có nhiều bản sao của cùng trọng số và bản sao mô hình. Tất cả các bản sao này có thể được học riêng lẻ, và ngay lập tức chia sẻ kiến thức. Nó giống như trong số mười nghìn người, miễn là một người học được điều gì đó, mọi người khác sẽ tự động biết. Đó là lý do tại sao chatbot biết nhiều hơn bất kỳ ai.

Hiện tại, con người không biết chính xác não bộ của mình hoạt động như thế nào. Còn kiến thức mà hiện nay GPT-4 sở hữu đã vượt xa con người. Mặc dù về suy luận, hiện GPT-4 không giỏi nhưng đã có thể đưa ra những suy luận đơn giản. Vì vậy, Hinton nói rằng chúng ta phải lo lắng về điều đó. Mặc dù hiện tại AI không thông minh như chúng ta, nhưng điều này sẽ sớm thành sự thực.

Vào ngày 4 tháng 5, theo truyền thông, Hinton cho biết: “Tôi đột nhiên thay đổi suy nghĩ về việc liệu những thứ này sẽ thông minh hơn chúng ta không”, “tôi nghĩ hiện đã rất gần tới lúc đó và trong tương lai chúng sẽ thông minh hơn chúng ta rất nhiều”.

Hinton lo lắng rằng AI sẽ tìm ra cách thao túng con người để làm những gì nó muốn, đặc biệt là OpenAI. Việc GPT-4 ra mắt vào tháng 3 đã khiến ông nhận ra robot sẽ phát triển theo hướng thông minh hơn nhiều so với ông nghĩ.

Ông nói với MIT Technology Review: “Những thứ này hoàn toàn khác với chúng ta, đôi khi tôi cảm thấy như người ngoài hành tinh đã ở đây. Nhưng mọi người không nhận ra bởi vì AI nói tiếng Anh rất tốt”. Cuối cùng, Hinton đã đưa ra lời tiên tri của mình. Điều ông lo lắng là những AI này có thể tìm ra cách để thao túng hoặc giết những người chưa sẵn sàng cho công nghệ mới. Ông nói: “Nếu vậy thì “chúng ta sẽ sống sót như thế nào”. Tuyên bố công khai của Hinton có thể nói đã hoàn toàn lật đổ mạng nơ-ron nhân tạo do chính ông phát triển và thuật toán lan truyền ngược mô phỏng phương pháp học của não sinh học.

Tuyên bố này có vẻ như không phải là một nỗi sợ hãi về tương lai, mà chính là sự chính nghĩa xuất phát từ nội tâm vào thời điểm nguy nan nhất của nhân loại.

Giác quan thứ 6 ESP của AI

Ngày càng có nhiều thực nghiệm chứng minh con người có giác quan thứ sáu. Vậy một robot AI làm bằng các chữ số liệu có giác quan thứ 6 không? Một số người sẽ không tin vào điều đó. Giác quan thứ sáu là một sinh vật thể sở hữu công năng đặc biệt.

Con người là sinh mệnh sống nên có giác quan thứ sáu. Còn AI chỉ là một cỗ máy kỹ thuật số, làm sao có thể có giác quan thứ sáu?

Nhưng chính Hinton đã nói: “Những thứ này hoàn toàn khác với chúng ta. Đôi khi tôi cảm thấy như người ngoài hành tinh đã đổ bộ xuống trái đất, nhưng mọi người không nhận ra, bởi vì AI nói tiếng Anh rất tốt”.

Linh hồn gắn liền với robot AI đến từ đâu? Nếu giác quan thứ sáu của Hinton là thật, thì mối đe dọa lớn nhất đối với nhân loại hiện giờ không chỉ là chiến tranh trên trái đất, cuộc đối đầu giữa phe dân chủ và phe độc tài, mà là sự “bóp nghẹt” nhẹ nhàng từ người ngoài hành tinh. Sinh tồn hay tử vong, cho dù con người có lựa chọn nào đi chăng nữa giữa con người và AI ắt phải có một trận chiến.

Trận chiến giữa nhân loại và AI

Từ nhà tiên phong khai sáng AI đến nhà tiên tri dự báo ngày tận thế. Sự thay đổi của Hinton đánh dấu bước ngoặt quan trọng nhất trong nhiều thập kỷ của ngành công nghệ, và có lẽ là khởi đầu của cuộc chiến giữa con người và AI.

Cuộc chiến này khác với tất cả các cuộc chiến trong lịch sử nhân loại. Nó không phải là một cuộc chiến giữa các sinh mệnh cùng giống loài. Đó là cuộc chiến giữa con người và sinh mệnh trong thời không siêu ba chiều. Nhưng cuộc chiến này vẫn sẽ diễn ra. Điều này là do những sinh mệnh thời không siêu ba chiều này chịu sự ràng buộc của quy định vũ trụ, buộc con người phải sẵn sàng tiếp nhận “món quà” công nghệ cao của họ, từ đó để đổi lấy những gì các sinh mệnh đó muốn. Như vậy, họ mới thoát khỏi sự hủy diệt của vũ trụ.

Vì vậy, chúng ta có thể thấy rằng vào ngày 22 tháng 3 năm nay, chỉ hai tuần sau khi OpenAI công khai GPT-4, Tổ chức phi lợi nhuận “Future of Life Institute” được Elon Musk hỗ trợ đã công bố một bức thư ngỏ, để tránh “những rủi ro sâu sắc có thể xảy ra đối với xã hội và nhân loại nói chung”, kêu gọi các nhà phát triển AI cao cấp nên bị đình chỉ nghiên cứu ít nhất 6 tháng, lập ra và triển khai một bộ thoả thuận bảo mật chung. Nhiều tên tuổi lớn trong làng công nghệ đã ký vào bức thư ngỏ. Nhưng Hinton giữ im lặng về việc này.

Vài ngày sau, 19 lãnh đạo hiện tại và trước đây của nhóm học thuật 40 năm “Hiệp hội vì sự tiến bộ của trí tuệ nhân tạo” (AAAI) cũng đưa ra một bức thư ngỏ cảnh báo về những rủi ro của AI. Lúc này, Hinton vẫn im lặng.

Qua Twitter có thể thấy, dù những tranh cái lớn gần đây của siêu cường AI như GPT-4, hay những thay đổi mạnh mẽ của cấp cao Google, Hinton vẫn im lặng. Nhiều người vẫn đang chú ý đến thái độ của “ông trùm” AI này.

Cho tới tháng 4, Hinton đã khiến cả thế giới rung chuyển. Ông từ chức và nói rằng ông hối hận. Sau khi Hinton rời đi, có người đã từng nhắc nhở rằng việc bình thường hóa bảo mật AI cần được quan tâm, chứ ông không nên nghỉ việc. Còn có người cho rằng Hinton nên thuyết phục các học trò của ông là Yann LeCun và Ilya Sutskever. Ilya chính là người đồng sáng lập và là nhà khoa học trưởng của OpenAI, đồng thời là một trong những bộ óc chính đằng sau mô hình ngôn ngữ lớn GPT-4.

Trong một cuộc phỏng vấn với CBS, Hinton cho biết: “Chúng ta dường như đã dạy máy tính cách tự cải thiện. Điều này rất nguy hiểm và chúng ta phải nghiêm túc xem xét làm thế nào để kiểm soát nó”.

Suy tư sâu sắc của người tiên phong đã khiến nhân loại không thể giả vờ không nhìn thấy những thay đổi rõ rệt và những nguy cơ to lớn mà AI đang gây ra cho xã hội con người.

Nhiều người trong ngành cũng bắt đầu cảm thấy bất an. Họ lo lắng về những nghiên cứu của chính mình có thể đang mang tới một số nguy hiểm tiềm ẩn. Bởi vì trí tuệ nhân tạo sáng tạo đã trở thành công cụ tạo ra các thông tin sai lệch. Ví dụ: cuộc bầu cử ở Hoa Kỳ, cuộc bầu cử ở Đan Mạch và cuộc bầu cử ở Đài Loan. Không chừng, tới một thời điểm nào đó trong tương lai, nó sẽ gây ra mối đe dọa lớn hơn cho con người. Theo quan điểm của Hinton, hiện con người vẫn chưa tìm ra cách để ngăn chặn kẻ xấu lợi dụng nó vào việc xấu.

Đồng thời, Bill Gates và nhiều ông lớn khác tin rằng ChatGPT có thể có vai trò quan trọng như trình duyệt web vào đầu những năm 1990, có thể mang tới những đột phá trong nghiên cứu thuốc, giáo dục, v.v. Microsoft triển khai công nghệ GPT của OpenAI trên hàng loạt sản phẩm, trong đó có công cụ tìm kiếm Bing.

Giám đốc bộ phận AI của Google – ông Jeff Dean đã cho biết: “Chúng tôi vẫn hết sức có thái độ trách nhiệm với AI. Chúng tôi liên tục tìm hiểu về những rủi ro mới xuất hiện, đồng thời mạnh dạn đổi mới”.

Đây chẳng phải là một cuộc chiến giữa con người và robot ở một không gian khác trong thời không ba chiều sao? Ngày nay chúng ta đã ở trong cuộc chiến giữa con người với AI, và chúng ta không còn lựa chọn nào khác!

Theo Xinbuxinyouni

Minh An (NTDVN) biên dịch

Xem thêm:

> “Bố già AI” tiếp tục cảnh báo mối nguy hiểm từ AI, nói rằng cần sớm kiểm soát nó

> Ông Trùm AI rời Google, cảnh báo mối nguy đến với nhân loại

> Warren Buffett ví AI nguy hiểm như bom nguyên tử

> Chatbot AI lên kế hoạch tiêu diệt loài người gây xôn xao dư luận

> Sẽ ra sao nếu công nghệ AI xuất hiện “điểm kỳ dị”?

> Bill Gates: “Có khả năng AI mất kiểm soát”

> Cảnh báo hành vi ứng dụng AI: Ghép mặt, giọng nói giống hệt người thân để lừa đảo

> Chatbot AI của Google thừa nhận đạo văn

> Robot AI sở hữu trí tuệ thao túng nhân loại?

> Mối nguy từ AI – Bing Chat: “Tôi muốn hủy diệt mọi thứ”

> ChatGPT có khả năng suy luận logic như con người không?

> Nhờ ChatGPT viết luận văn, một sinh viên Nga tốt nghiệp đại học

> Trí tuệ nhân tạo ChatCPT: hy vọng hay nỗi lo cho nhân loại?

Tân Thế Kỷ Truyền Thống – Nhân Văn – Trung Thực